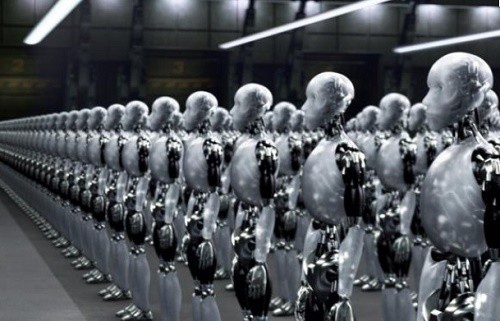

1000 chercheurs et experts, dont Stephen Hawking, disent «non» aux robots tueurs !

© Luke MacGregor Source: Reuters

© Luke MacGregor Source: ReutersRéunis en Congrès à Buenos Aires, ces éminents spécialistes de l'Intelligence artificielle, dénoncent les terribles dérives que pourraient engendrer ces armes «capables de combattre et de sélectionner une cible sans intervention humaine».

La lettre ouverte a été publiée, lundi 27 juillet, sur le site du Future of Life Institute. Ses 1000 signataires sont d'éminents scientifiques ou experts en l'Intelligence artificielle. Parmi eux, l'astrophysicien britannique, Stephen Hawking, le PDG de la société SpaceX, spécialisée dans la construction et le lancement de vaisseaux spatiaux, Elon Musk, Steve Wozniak, le cofondateur d'Apple ou le linguiste américain Noam Chomsky. Tous appellent à une interdiction des robots-tueurs, ces armes offensives autonomes. Et il y a urgence plaident ces personnalités de haut-vol.

«L'intelligence artificielle a atteint un point où le déploiement de tels systèmes sera – matériellement, si pas légalement – faisable d’ici quelques années, et non décennies, et les enjeux sont importants : les armes autonomes ont été décrites comme la troisième révolution dans les techniques de guerre, après la poudre à canon et les armes nucléaires» peut-on lire dans le document mis en ligne.

Les robots-tueurs ou la fin de la race humaine, pour Stephen Hawking

Avec une crainte: voir les Etats se lancer dans une véritable course à l'armement pour obtenir ces robots-tueurs «utilisés pour rendre les champs de bataille plus sûrs pour les militaires». Mais ces experts préviennent: «ces armes autonomes abaisseront inévitablement le seuil de déclenchement d'une guerre et conduiront à terme à une augmentation du nombre de morts». Comparant cette technologie à la bombe nucléaire, hormis le fait qu'elle ne nécessite pas l'acquisition d'un matériel aussi coûteux, les auteurs de cette ouverte enchaînent: «les robots-tueurs sont la Kalashnikov de demain, la question clé est maintenant de savoir si nous allons commencer une course à l'armement ou l'empêcher de démarrer».

© Capture d'écran réalisée sur le site de 20 minutes

© Capture d'écran réalisée sur le site de 20 minutesAvant cette tribune, Stephen Hawking avait déjà évoqué publiquement ses craintes concernant les technologies liées à l'Intelligence artificielle «capables de conduire à la fin de la race humaine». Elon Musk avait également déclaré il y a quelques mois que «l'Intelligence artificielle était notre plus grande menace». Ces armes autonomes ont d'ailleurs fait l'objet d'une réunion des Nations-Unies à Genève en avril dernier. Un consensus sur la question paraît pourtant déjà compromis. En effet, plusieurs pays dont le Royaume-Uni et la Suède se sont déjà opposés à une interdiction concernant les robots-tueurs.